- Home

- Ética y algoritmos

- Minería de Datos a Cielo Abierto sin Regulaciones Claras: Desafíos Técnicos y Éticos.

Minería de Datos a Cielo Abierto sin Regulaciones Claras: Desafíos Técnicos y Éticos.

![]() Claudio MartinezÉtica y algoritmos2 months ago196 Views

Claudio MartinezÉtica y algoritmos2 months ago196 Views

El pacto que firmamos sin leer.

Marzo de 2020. La pandemia acelera dramáticamente la adopción de soluciones digitales que, en condiciones normales, habrían requerido años de implementación gradual. Aplicaciones móviles gubernamentales, plataformas de e-commerce, infraestructuras de trabajo remoto. Todo desplegado con una urgencia que redujo significativamente los ciclos de evaluación técnica y ética.

Desde mi experiencia liderando proyectos de datos e inteligencia artificial en el sector público y privado, he observado cómo esa aceleración dejó consecuencias estructurales. La analogía más precisa para describir el fenómeno actual es la de la minería a cielo abierto: extracción masiva, continua y visible, pero cuya verdadera profundidad e impacto permanecen opacos para quienes son fuente de esos recursos.

A diferencia de la minería tradicional, donde la extracción es geográficamente delimitada, la recolección de datos es ubicua, constante y prácticamente invisible en su operación diaria.

La extracción silenciosa: datos como recurso sin costo marginal.

En mi trabajo analizando aplicaciones móviles de gobiernos locales y plataformas corporativas, he documentado un patrón consistente: ciudadanos y usuarios proporcionando datos biométricos, de geolocalización, patrones de comportamiento y consumo, frecuentemente con un nivel de comprensión limitado sobre el procesamiento posterior de esa información.

Esto no responde a negligencia por parte de los usuarios, sino a una arquitectura de elección diseñada donde la necesidad es urgente y las alternativas son escasas o inexistentes.

La economía de plataformas opera sobre este principio estructural: las infraestructuras digitales se posicionan como intermediarias críticas entre usuarios y servicios esenciales. Su modelo económico se fundamenta en la conversión de millones de usuarios en fuentes de datos con un costo de adquisición marginal tendiente a cero, transformando esos datos en el activo de mayor valor en la economía digital contemporánea.

La diferencia con la minería tradicional es significativa: en la extracción de recursos naturales existen (al menos nominalmente) estudios de impacto ambiental, evaluaciones de riesgo, procesos de consulta pública. En la economía de datos, los mecanismos de consentimiento se reducen a términos y condiciones extensos, redactados en lenguaje técnico-jurídico de difícil comprensión para usuarios no especializados.

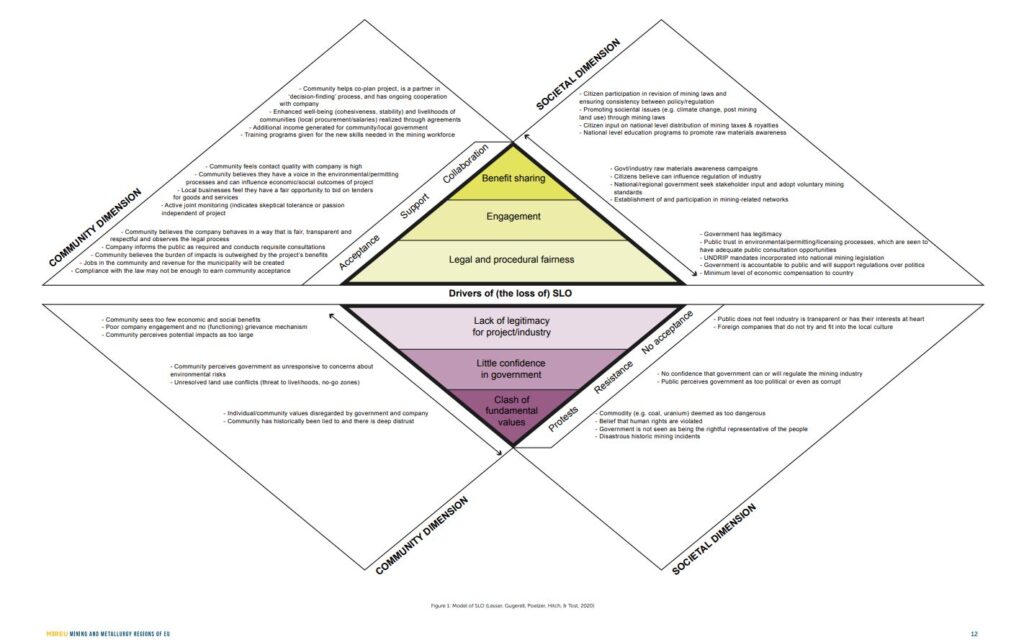

Licencia Social 2.0: Del mineral al algoritmo.

Aquí es donde el concepto de Licencia Social se vuelve devastadoramente relevante para quienes trabajamos en gobernanza de datos.

En la industria minera extractivista, la Licencia Social para Operar (LSO) se construye sobre tres pilares:

-

- Legitimidad: percepción de que la operación es apropiada

-

- Credibilidad: creencia en que la empresa actúa con honestidad

-

- Confianza: certeza de que cumplirá sus compromisos

Ahora traslademos esto al mundo digital: ¿Cuántas veces hemos visto a usuarios aceptar términos de servicio que son “en buena parte desconocidos o no especificados”, simplemente porque necesitan acceder a un servicio?

Esa es nuestra Licencia Social digital: una aceptación creciente, casi resignada, de condiciones opacas a cambio de resolver necesidades prácticas inmediatas.

Y aquí emerge el dilema ético central que atraviesa nuestro rol como CDOs y DPOs: los algoritmos no son artefactos neutrales. Son sistemas diseñados por equipos humanos con objetivos específicos, frecuentemente alineados con intereses comerciales o políticos, y cuyas decisiones pueden amplificar o crear nuevas asimetrías de poder.

Lo que podríamos denominar opacidad sistémica: una condición donde la complejidad técnica legítima se convierte en mecanismo estructural de evasión de responsabilidad (accountability). La opacidad algorítmica no es simplemente un desafío técnico de explicabilidad; es un fenómeno sociotécnico donde las barreras al escrutinio público se construyen tanto en el código como en las estructuras organizacionales que lo rodean.

El vacío regulatorio argentino: navegando sin brújula normativa.

Mientras escribo esto en noviembre del 2025, observamos un desarrollo regulatorio heterogéneo en la región: Chile ha implementado su Política Nacional de Inteligencia Artificial, la Unión Europea ha establecido el AI Act con enfoque basado en riesgos, y Estados Unidos avanza en marcos regulatorios sectoriales.

En el contexto argentino, la Ley 25.326 de Protección de Datos Personales (2000) constituyó un avance significativo en su momento, pero enfrenta limitaciones estructurales para abordar los desafíos del procesamiento masivo de datos (Big Data), aprendizaje automático y economías de plataforma.

La ausencia de un marco normativo específico para sistemas de inteligencia artificial genera una brecha regulatoria: no existen evaluaciones de impacto algorítmico obligatorias, registros de sistemas de alto riesgo, ni mecanismos estandarizados de auditoría para decisiones automatizadas.

Esta situación coloca a quienes lideramos áreas de gobernanza de datos en una posición paradójica: debemos construir frameworks robustos de gestión de riesgo sin referencias normativas claras que definan el piso mínimo de compliance. La pregunta metodológica es ¿cómo justificar inversiones en privacy by design cuando no existe obligación legal explícita, pero sí riesgo reputacional y ético creciente?

El dilema del CDO/DPO: Tensiones estructurales en la gobernanza de datos.

Desde la práctica profesional en posiciones de liderazgo de datos, identifico cuatro tensiones estructurales recurrentes:

Tensión 1: Velocidad de implementación vs. Robustez en protección.

Las áreas de negocio requieren acceso a datos con ciclos de implementación cada vez más comprimidos. Cada control adicional es percibido como fricción que ralentiza la entrega de valor.

Sin embargo, esta “fricción” constituye la diferencia entre uso legítimo basado en necesidad y propósito, versus procesamiento oportunista que excede las bases legales establecidas.

Tensión 2: Complejidad técnica vs. Explicabilidad efectiva.

Los sistemas de IA contemporáneos presentan complejidad técnica objetiva: arquitecturas de redes neuronales profundas con millones de parámetros, procesos de entrenamiento que incluyen ajustes estocásticos, y emergencia de patrones que no son directamente interpretables.

Esta complejidad no puede funcionar como justificación para evadir accountability. El desafío metodológico para un DPO es: ¿cómo comunicar a un titular de datos las razones de una decisión automatizada adversa (ej. rechazo crediticio) cuando el propio equipo técnico no puede descomponer linealmente el peso de cada variable en el resultado?

Tensión 3: Autorregulación vs. Enforcement externo.

En contextos de indefinición normativa, muchas organizaciones optan por esquemas de autorregulación: códigos de ética corporativa, comités de IA, marcos de principios declarativos.

La evidencia histórica sugiere que la autorregulación sin mecanismos de enforcement externo tiende a degradarse bajo presión comercial. Los principios éticos bien intencionados suelen ceder ante imperativos de mercado cuando no existe riesgo regulatorio concreto.

Tensión 4: Asimetría de información y conocimiento ciudadano.

La investigación empírica sobre aplicaciones gubernamentales y corporativas revela consistentemente: la mayoría de usuarios desconoce sus derechos bajo Ley 25.326 (derechos ARCO: Acceso, Rectificación, Cancelación, Oposición), no comprende conceptos técnicos como “perfilamiento” o “decisiones automatizadas”, y carece de herramientas cognitivas para evaluar términos de servicio complejos.

Esta brecha de conocimiento no es accidental. Es resultado de diseño deliberado en arquitecturas de elección.

Como profesionales de gobernanza, enfrentamos la paradoja de intentar construir mecanismos de consentimiento informado en poblaciones donde la información asimétrica es estructural, y donde proporcionar información completa y comprensible podría resultar comercialmente inviable.

Estrategias de gobernanza en contextos de incertidumbre regulatoria.

A pesar del escenario descrito, existen espacios de acción estratégica para profesionales en posiciones de gobernanza de datos:

1. Documentación proactiva y trail of accountability

En ausencia de obligaciones regulatorias explícitas, la creación voluntaria de registros documentales genera valor estratégico:

-

- Inventarios exhaustivos de sistemas de IA clasificados por nivel de riesgo

-

- Evaluaciones de impacto en privacidad (Privacy Impact Assessments) aplicadas preventivamente

-

- Registros de decisiones de diseño y análisis de trade-offs éticos-técnicos

Cuando llegue armonización regulatoria (tendencia regional observable), las organizaciones con documentación robusta tendrán ventaja competitiva significativa en plazos de adaptación.

2. Construcción de coaliciones internas y gobernanza distribuida.

La efectividad del rol de DPO depende críticamente de su posición en la estructura organizacional. La gobernanza de datos efectiva requiere:

-

- Coordinación con áreas legales para articular riesgos regulatorios y reputacionales

-

- Partnership estratégico con seguridad de información, aprovechando frameworks establecidos de gestión de riesgo

-

- Colaboración temprana con equipos de producto para implementar privacy by design desde etapas conceptuales

La gobernanza de datos no es función de un área especializada aislada, sino capacidad organizacional distribuida.

3. Transparencia algorítmica como estrategia de diferenciación.

En mercados caracterizados por opacidad generalizada, la transparencia opera como vector de diferenciación competitiva. Organizaciones capaces de comunicar efectivamente:

-

- Qué categorías de datos procesan y con qué bases legales específicas

-

- Cómo operan sus sistemas algorítmicos en términos accesibles para audiencias no técnicas

-

- Qué mecanismos implementan para detectar y mitigar sesgos y discriminación

Estas organizaciones construyen capital de confianza genuino, diferente de la licencia social obtenida por ausencia de alternativas.

4. Preparación para marcos de “Derecho a exclusión algorítmica”.

Diversos ordenamientos jurídicos están evaluando el reconocimiento del derecho de personas a excluirse de procesos tecnológicos donde sus datos sean procesados para perfilamiento automatizado o vigilancia.

Preguntas estratégicas para líderes de datos:

-

- ¿Puede su organización ofrecer servicios equivalentes sin dependencia de perfilamiento masivo?

-

- ¿Existen procesos alternativos no automatizados para decisiones críticas?

-

- ¿Qué porcentaje de la propuesta de valor es indisociable de procesamiento intensivo de datos personales?

La sostenibilidad de modelos de negocio basados exclusivamente en explotación de datos personales enfrenta cuestionamiento regulatorio creciente.

La minería de datos como fenómeno sociotécnico complejo.

La analogía con la minería extractivista tradicional resulta útil para comprender dimensiones estructurales del fenómeno:

-

- Los impactos no son inmediatos sino acumulativos y sistémicos

-

- Las poblaciones afectadas frecuentemente identifican consecuencias negativas con retraso temporal significativo

-

- Los costos de remediación exceden exponencialmente las inversiones preventivas

-

- Existe distribución asimétrica de beneficios (concentrados) versus costos (distribuidos)

La diferencia cualitativa con la minería tradicional radica en que, en la economía de datos, todos somos simultáneamente comunidad afectada y fuente del recurso extraído.

Quienes ocupamos posiciones de gobernanza —Chief Data Officers, Data Protection Officers, equipos de ética de IA— enfrentamos una responsabilidad que trasciende el compliance formal. Operamos como mediadores entre modelos de negocio basados en extracción intensiva de datos y la protección de derechos fundamentales de personas.

Esta no es una posición cómoda. Requiere capacidad de articular valor económico de la protección de datos (no solo como costo regulatorio), habilidad para construir coaliciones internas, y resiliencia para mantener estándares éticos bajo presión comercial.

El momento histórico demanda profesionales capaces de navegar complejidad técnica, ambigüedad normativa y tensiones organizacionales, sin renunciar a principios de dignidad humana y autodeterminación informativa que fundamentan el derecho a la protección de datos personales.

Related Posts

Stay Informed With the Latest & Most Important News

Previous Post

Next Post

Recent Posts

- ¿Es momento de un Chief Research Officer?

- Del Click al Servidor: Anatomía de la Medición Digital Moderna

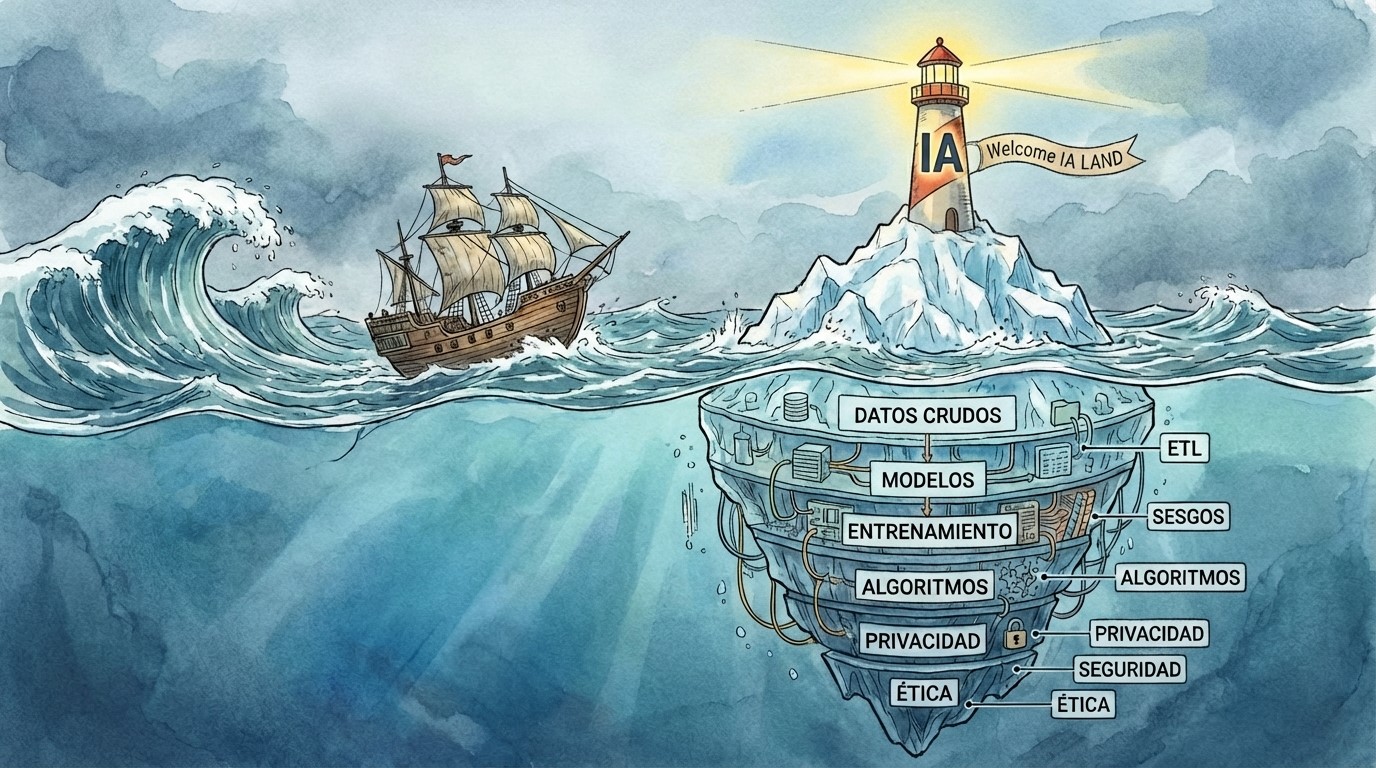

- El iceberg de la IA: momentos para navegar con precaución

- Minería de Datos a Cielo Abierto sin Regulaciones Claras: Desafíos Técnicos y Éticos.

- JAX-Privacy y el nuevo estándar de IA auditable: qué cambia para ingenieros y DPOs (Parte II)