- Home

- Data governance

- JAX-Privacy y el nuevo estándar de IA auditable: qué cambia para ingenieros y DPOs (Parte II)

JAX-Privacy y el nuevo estándar de IA auditable: qué cambia para ingenieros y DPOs (Parte II)

![]() Claudio MartinezData governance2 months ago230 Views

Claudio MartinezData governance2 months ago230 Views

De las promesas a los parámetros: cómo JAX-Privacy reescribe las reglas para DPOs.

Si leíste la primera parte, ya sabés que JAX-Privacy no es solo “otra librería más” de otra solución de Google. Es la primera herramienta lista para producción que te permite entrenar modelos grandes con privacidad diferencial y—esto es clave—medirlo y probarlo.

Ahora viene la pregunta del millón: ¿y eso qué cambia en el día a día de un equipo o un proyecto de Data y IA? Si sos DPO, abogado de tecnología, o simplemente alguien que tiene que aprobar proyectos de IA sin perder el sueño, acá te cuento por qué esto te va a importar y seguramente cuando tu área lo implemente te acordarás de mí.

El fin de las EIPD/DPIA decorativas

Seamos honestos: muchas Evaluaciones de Impacto EIPD, (o DPIA, Data Protection Impact Assessment en inglés ) de proyectos de IA son bastante… decorativas. Llenas de frases que suenan bien pero dicen poco:

-

- “Se aplican técnicas de seudonimización y minimización de datos”

-

- “Se han tomado medidas para evitar la reidentificación”

-

- “El acceso a los datos está restringido a personal autorizado”

Todo suena profesional, prolijo y muy proactivo, listo para pasar una auditoría para el ENS o la ISO 27001. El problema es cuando llega alguien y te pregunta: “¿Podés demostrar eso?” Ahí se complica todo, tanto a nivel técnico como de procesos.

Con JAX-Privacy entra un lenguaje completamente distinto a la conversación. Ya no hablás de intenciones, hablás de números, cuestiones un poco más técnicas:

-

- Presupuesto de privacidad: epsilon 8, delta 10^-6

-

- Configuración de entrenamiento: clipping norm 1.0, noise multiplier 0.8, batch size 4096

-

- Accounting de privacidad: librería RDP (Rényi Differential Privacy) con logs completos

-

- Auditoría empírica: pruebas con canaries para medir memorización del modelo

Esto no significa que el DPO tenga que convertirse en científico de datos. Pero sí significa que ahora que ahora como DPO, encargado de velar por la seguridad de la información de los usuarios, podés exigir evidencia técnica específica en lugar de aceptar promesas vagas basadas en lenguajes técnicos grandilocuentes.

Imaginate ir a una auditoría con el regulador y en vez de decir “confiamos en nuestros controles”, podés mostrar:

-

- El pipeline de entrenamiento configurado con privacidad diferencial

-

- Los parámetros exactos que se usaron

-

- Los logs de la librería mostrando el budget de privacidad consumido

-

- Resultados de auditorías que demuestran que el modelo no está memorizando datos individuales

Es la diferencia entre “nosotros cuidamos la privacidad” y “acá está la evidencia matemática de que lo hicimos”.

Privacy by design ya no es solo filosofía, se convierte en una práctica 100% medible.

El artículo 25 del RGPD te obliga a proteger datos “desde el diseño y por defecto”. Durante años eso se tradujo en cosas como:

-

- Revisar qué datos realmente necesitás (bien)

-

- Documentar tus decisiones (bien)

-

- Implementar controles de acceso (bien)

-

- …y después cruzar los dedos cuando entrenás el modelo (no tan bien)

El problema es que entre “decidir qué datos usar” y “entrenar el modelo”, hay un agujero negro, o mejor dicho una verdadera caja negra, hace un tiempo escribí un artículo sobre este tema, que todos medianamnete “intuyen” pero poco se habla, lo dejo si te interesa, se llama “Abramos la caja negra de la IA: por qué la interpretabilidad es clave para una IA generativa segura y confiable.”. El modelo en sí mismo es un artefacto que procesa datos personales de forma masiva, y hasta ahora no teníamos una forma clara de garantizar que ese procesamiento respetara la privacidad a nivel técnico.

JAX-Privacy cierra ese agujero. Te da una forma concreta de implementar privacy by design en la etapa de entrenamiento:

-

- Configurás tu pipeline con privacidad diferencial desde el arranque

-

- Definís tu presupuesto de privacidad antes de entrenar

-

- El algoritmo garantiza que el modelo no pueda memorizar individuos más allá de ese presupuesto

-

- Al final, podés auditar que efectivamente se cumplió

Para un DPO, esto es oro cuando tenés que justificar ante el regulador que no solo cumpliste los principios generales del RGPD, sino que adoptaste medidas técnicas alineadas con el estado del arte.

Y ojo: “estado del arte” es un término legal que importa. No significa “lo más nuevo”, significa “lo que la comunidad técnica considera como buena práctica actual”. Con Google, Microsoft, y otros gigantes implementando privacidad diferencial en producción, cada vez va a ser más difícil argumentar que “no era factible”, esto encierra sin lugar a dudas un gran desafío para quien ostenta la labor de DPO y sus equipos.

El dilema es el mismo en todos lados

Una de las cosas que más me gusta de esto es que el impacto es simétrico. No importa si trabajás en el sector público o privado, el dilema es el mismo: querés usar datos reales sin traicionar la confianza de la gente.

Si estás en el sector público

Pensá en estos casos:

Un ministerio de salud quiere entrenar un modelo para apoyo al diagnóstico usando historiales de varios hospitales. Categoría especial de datos, millones de registros, tratamiento de alto riesgo. DPIA obligatoria.

¿Qué pasa hoy? La respuesta típica es: “esto es demasiado arriesgado, mejor no lo hacemos”. O peor: se hace en piloto eterno que nunca llega a producción porque nadie se atreve a firmar.

¿Qué podría pasar con privacidad diferencial?

“Vamos a entrenar el modelo de forma que matemáticamente el impacto de cada paciente individual esté acotado. Acá está cómo lo configuramos, acá están los parámetros, acá están las auditorías. El riesgo está cuantificado y es razonable.”

No elimina el riesgo. Pero lo vuelve defendible.

Lo mismo aplica para una administración tributaria que quiere detectar patrones de fraude, o un municipio que quiere usar IA para identificar situaciones de riesgo social. Son casos donde la IA puede ayudar muchísimo, pero el riesgo de privacidad frena todo.

Si estás en el sector privado

Del otro lado, las empresas tienen sus propios dolores de cabeza:

-

- Bancos y fintech queriendo usar IA para scoring de crédito, detección de fraude, perfilado de clientes

-

- Aseguradoras con modelos de tarificación dinámica basados en comportamiento

-

- Retail y plataformas digitales construyendo modelos de recomendación con datos granulares de usuario

-

- Empresas que quieren afinar sus LLMs internos con tickets de soporte, correos o chats de clientes

Si estás del lado de negocio, el incentivo es claro: “cuanto más dato, mejor modelo”.

Si estás del lado DPO/compliance, la sensación es: “esto es una bomba de relojería si no se hace bien”.

JAX-Privacy no es una solución mágica que alinea esos intereses, pero sí establece un nuevo nivel de referencia. Demuestra que se pueden entrenar modelos grandes con privacidad diferencial sin sacrificar precisión de forma dramática. Y baja la barrera técnica para que los equipos de datos experimenten con DP de forma estructurada.

Como DPO, eso te da leverage. Ya no tenés que aceptar “confiá en nosotros”. Podés exigir criterios técnicos concretos.

El mensaje de fondo.

Hace un año, hablar de privacidad diferencial en una reunión con gente de legal, negocio e ingeniería era casi garantía de miradas perdidas. Sonaba a paper académico, algo lejano y poco práctico.

El lanzamiento de JAX-Privacy 1.0 no resuelve todos los problemas. Sigue requiriendo expertise técnico, decisiones de diseño complejas, trade-offs entre privacidad y utilidad. Pero marca un punto de inflexión importante:

La privacidad puede ser una propiedad medible y auditable del entrenamiento, no solo una promesa en un documento.

Para los ingenieros, esto significa herramientas concretas.

Para los DPOs, argumentos sólidos.

Para las organizaciones —públicas y privadas—, la posibilidad de dejar de elegir entre “innovar con IA” o “dormir tranquilos con la privacidad”.

Ahora podemos empezar a diseñar sistemas donde ambas cosas van de la mano. Con números, controles y evidencias.

Y honestamente, después de tantos años viendo proyectos de IA frenados por miedo normativo (a veces justificado, a veces no), esto se siente como un cambio de paradigma real.

Related Posts

Stay Informed With the Latest & Most Important News

Previous Post

Next Post

Recent Posts

- ¿Es momento de un Chief Research Officer?

- Del Click al Servidor: Anatomía de la Medición Digital Moderna

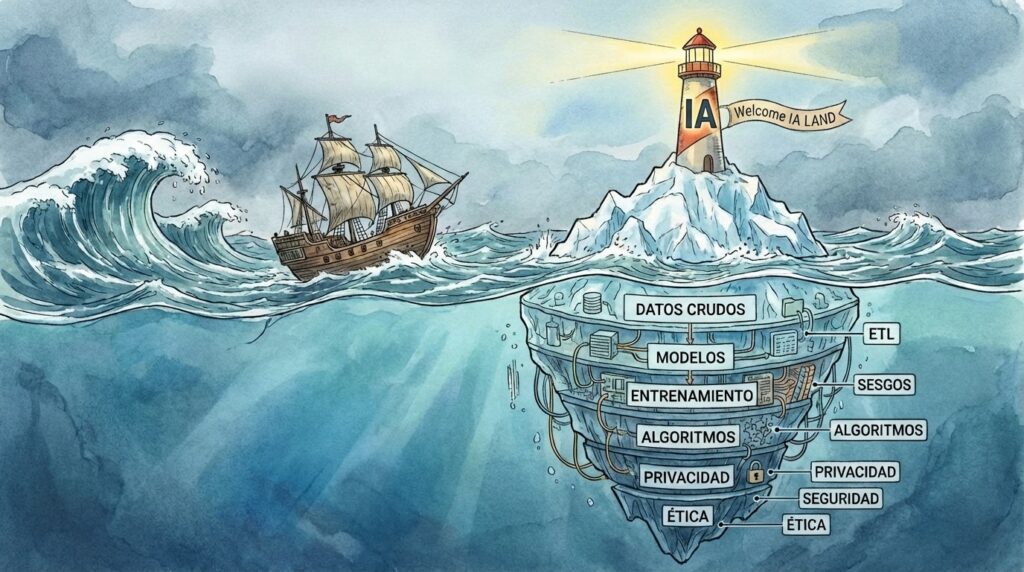

- El iceberg de la IA: momentos para navegar con precaución

- Minería de Datos a Cielo Abierto sin Regulaciones Claras: Desafíos Técnicos y Éticos.

- JAX-Privacy y el nuevo estándar de IA auditable: qué cambia para ingenieros y DPOs (Parte II)